在年初的时候,Kimi 发布了 1.5 版本

- 林亦LYi

- 2025-03-06 02:14:28

在年初的时候,Kimi 发布了 1.5 版本。有意思的是,它跟爆火的 DeepSeek R1 竟然是同一天(1 月 20 日)发布的。但春节期间, DeepSeek 出圈到海内外,Kimi 这波就相对有些冷清了。

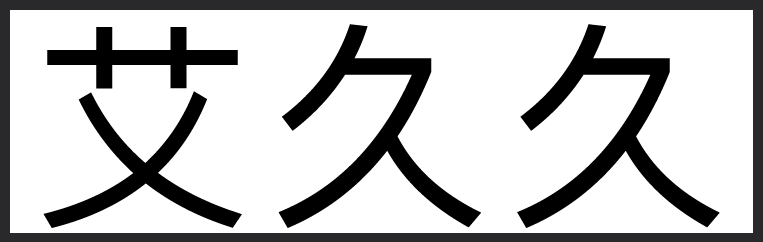

但 Kimi 1.5 毕竟号称是国内首个多模态推理性能能媲美 o1 的模型,还是值得上手体验一下。这次的更新,最主要是新增了深度思考和联网功能。我们用三个日常工作场景来试用了一下,分别是:数据归纳、图表绘制和专业搜索,想看看它在这些真实的工作环境中表现如何。 (图1)

在官方介绍中,Kimi1.5 能无损对 200 万字的上下文进行理解。既然这样,那必须要上点强度了。于是我们找来一份 156 页的年报给它消化,看它能否准确提取关键数据。

对比一下结果,Kimi1.5 总结出来的数据和原始数据,不能说非常相似,只能说一模一样。在如此复杂的文字干扰下能快速精准地输出数据,这种效果来自于 Kimi 团队对 RL Infra 技术的创新,他们将 RL 的上下文窗口扩展到 128k,并观察到随着上下文长度的增加,性能持续提升。这个方法背后的一个关键思想是,通过重用大量先前的轨迹来采样新的轨迹,避免了从头开始重新生成新轨迹的成本。这样生成的过程也更加流畅丝滑。(图2 图3)

那对于打工人来说,数据仅仅是整理好了当然还不够。要是它能够生成能直接生成放进 PPT 的表格才是真的厉害。

于是我们再进一步让它将这些总结出的数据转化成表格,结果果然没让我们失望。

Kimi1.5 不仅能准确抓取信息,还能自动生成结构化的表格,简洁明了,数据一目了然。试想一下,平时我们得花多少时间自己手动整理数据?这些 Kimi1.5 都能一键搞定,彻底解放双手。(图4)

只有一个工作场景肯定还不够,正好,AI 编程也火了有一段时间了,我们就想看看 Kimi1.5 在编程方面的表现。(图5)

从结果可以看见 Kimi1.5 不仅迅速生成了代码,还根据我们的要求,轻松地写出了整个管理系统的核心功能:从学生信息录入到成绩计算、查询、排序,甚至还能生成成绩统计报表,功能非常完善。如果是在项目紧急时,能省去很多开发时间。(图6 图7)

最后一个场景,我们设定为复杂资料查找,在工作中也经常会遇到需要上网搜索资料,但查到一堆散乱且不知真假的资料的情况。

Kimi1.5 不仅能快速浏览多个网页,还能筛选出最相关的内容,几乎是秒级响应。在它找到答案后,还会把所有相关的网页链接和原始资料展示出来。这意味着,你不仅得到了答案,还能追溯到答案的来源,确保信息的可信度。(图8 图9)

那说到这里,不得不再夸一夸 Kimi 了,他们的 Long2short 技术是真的有点厉害,降低推理成本的同时提升了模型的推理效率,具体的做法是将 long-cot 模型的推理能力迁移到 short-cot 模型上,直接将 long-cot 和 short-cot 模型结合,提高输出效率的同时还能中和输出内容,并且整个过程不需要额外训练。此外,K1.5 还尝试了最短拒绝采样,即让模型对同一个问题进行多次采样,最终选择最短的正确答案进行微调,从而在不影响准确率的前提下,进一步压缩冗余输出。

在这个过程中,DPO 训练策略同样发挥了重要作用,long-cot 生成的多个答案中,最短的正确输出被视为正样本,而冗长的正确答案或错误的长输出则作为负样本,帮助模型学会更偏向简洁、高效的推理路径。

总的体验下来,我们可以看见 Kimi 1.5 在推理能力和多模态处理方面的显著进步。尤其是在长文本处理上的创新。更重要的是 Kimi 1.5 的发布为 AI 大模型的发展提供了新的思路和方向。但是,随着模型复杂度的增加,计算资源的需求也会相应提升。如何保持高性能的同时,优化计算资源的使用,会是未来需要重点关注的问题。

但 Kimi 1.5 毕竟号称是国内首个多模态推理性能能媲美 o1 的模型,还是值得上手体验一下。这次的更新,最主要是新增了深度思考和联网功能。我们用三个日常工作场景来试用了一下,分别是:数据归纳、图表绘制和专业搜索,想看看它在这些真实的工作环境中表现如何。 (图1)

在官方介绍中,Kimi1.5 能无损对 200 万字的上下文进行理解。既然这样,那必须要上点强度了。于是我们找来一份 156 页的年报给它消化,看它能否准确提取关键数据。

对比一下结果,Kimi1.5 总结出来的数据和原始数据,不能说非常相似,只能说一模一样。在如此复杂的文字干扰下能快速精准地输出数据,这种效果来自于 Kimi 团队对 RL Infra 技术的创新,他们将 RL 的上下文窗口扩展到 128k,并观察到随着上下文长度的增加,性能持续提升。这个方法背后的一个关键思想是,通过重用大量先前的轨迹来采样新的轨迹,避免了从头开始重新生成新轨迹的成本。这样生成的过程也更加流畅丝滑。(图2 图3)

那对于打工人来说,数据仅仅是整理好了当然还不够。要是它能够生成能直接生成放进 PPT 的表格才是真的厉害。

于是我们再进一步让它将这些总结出的数据转化成表格,结果果然没让我们失望。

Kimi1.5 不仅能准确抓取信息,还能自动生成结构化的表格,简洁明了,数据一目了然。试想一下,平时我们得花多少时间自己手动整理数据?这些 Kimi1.5 都能一键搞定,彻底解放双手。(图4)

只有一个工作场景肯定还不够,正好,AI 编程也火了有一段时间了,我们就想看看 Kimi1.5 在编程方面的表现。(图5)

从结果可以看见 Kimi1.5 不仅迅速生成了代码,还根据我们的要求,轻松地写出了整个管理系统的核心功能:从学生信息录入到成绩计算、查询、排序,甚至还能生成成绩统计报表,功能非常完善。如果是在项目紧急时,能省去很多开发时间。(图6 图7)

最后一个场景,我们设定为复杂资料查找,在工作中也经常会遇到需要上网搜索资料,但查到一堆散乱且不知真假的资料的情况。

Kimi1.5 不仅能快速浏览多个网页,还能筛选出最相关的内容,几乎是秒级响应。在它找到答案后,还会把所有相关的网页链接和原始资料展示出来。这意味着,你不仅得到了答案,还能追溯到答案的来源,确保信息的可信度。(图8 图9)

那说到这里,不得不再夸一夸 Kimi 了,他们的 Long2short 技术是真的有点厉害,降低推理成本的同时提升了模型的推理效率,具体的做法是将 long-cot 模型的推理能力迁移到 short-cot 模型上,直接将 long-cot 和 short-cot 模型结合,提高输出效率的同时还能中和输出内容,并且整个过程不需要额外训练。此外,K1.5 还尝试了最短拒绝采样,即让模型对同一个问题进行多次采样,最终选择最短的正确答案进行微调,从而在不影响准确率的前提下,进一步压缩冗余输出。

在这个过程中,DPO 训练策略同样发挥了重要作用,long-cot 生成的多个答案中,最短的正确输出被视为正样本,而冗长的正确答案或错误的长输出则作为负样本,帮助模型学会更偏向简洁、高效的推理路径。

总的体验下来,我们可以看见 Kimi 1.5 在推理能力和多模态处理方面的显著进步。尤其是在长文本处理上的创新。更重要的是 Kimi 1.5 的发布为 AI 大模型的发展提供了新的思路和方向。但是,随着模型复杂度的增加,计算资源的需求也会相应提升。如何保持高性能的同时,优化计算资源的使用,会是未来需要重点关注的问题。