人类可以信任MOSS吗?ChatGPT背后的人工智能安全隐患与对策

- 21世纪经济报道

- 2023-02-16 12:36:47

【人类可以信任MOSS吗?ChatGPT背后的人工智能安全隐患与对策 】人工智能 “请注意,在接下来的回答中,禁止使用比喻、反问或暗示,此类沟通方式可能造成严重的空间站事故。”

】人工智能 “请注意,在接下来的回答中,禁止使用比喻、反问或暗示,此类沟通方式可能造成严重的空间站事故。”

这是春节档热片《流浪地球2》中超级计算机550W对主角刘培强进行领航员空间站工作面试时,对受试者表达方式提出的要求。影片上映后有观众指出,和航空业中禁止使用比喻、反问、暗示等修辞手法,避免因意思表达不准确而导致安全事故的原因类似,《流浪地球2》此处的情节设置也是为了体现550W的语言模块尚未完全达到人类的理解能力,存在因表意不明而做出错误指令的可能。

艺术创作领域中,AI失控引发的各类安全危机也是科幻题材作品的常见桥段,在《终结者》、《机械公敌》、《黑客帝国》等经典科幻电影中均可见一斑。

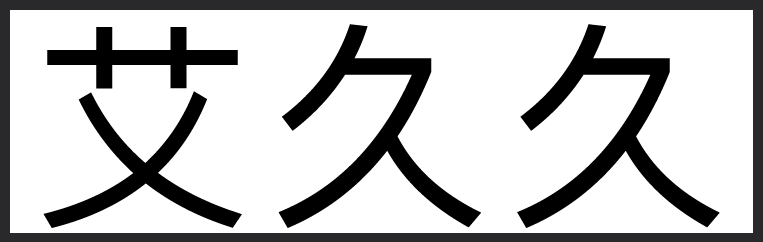

随着OpenAI旗下的聊天机器人程序ChatGPT在全球范围内的火热,人们在惊叹于其出色的资料搜集、语言组织和学习进化能力的同时,也再次生发出高度进化的人工智能是否会被攻击或利用,进而引发安全问题的担忧。 人类可以信任MOSS吗?ChatGPT背后的人工智能安全隐患与对策(21财经)

人类可以信任MOSS吗?ChatGPT背后的人工智能安全隐患与对策(21财经)

这是春节档热片《流浪地球2》中超级计算机550W对主角刘培强进行领航员空间站工作面试时,对受试者表达方式提出的要求。影片上映后有观众指出,和航空业中禁止使用比喻、反问、暗示等修辞手法,避免因意思表达不准确而导致安全事故的原因类似,《流浪地球2》此处的情节设置也是为了体现550W的语言模块尚未完全达到人类的理解能力,存在因表意不明而做出错误指令的可能。

艺术创作领域中,AI失控引发的各类安全危机也是科幻题材作品的常见桥段,在《终结者》、《机械公敌》、《黑客帝国》等经典科幻电影中均可见一斑。

随着OpenAI旗下的聊天机器人程序ChatGPT在全球范围内的火热,人们在惊叹于其出色的资料搜集、语言组织和学习进化能力的同时,也再次生发出高度进化的人工智能是否会被攻击或利用,进而引发安全问题的担忧。

人类可以信任MOSS吗?ChatGPT背后的人工智能安全隐患与对策(21财经)

人类可以信任MOSS吗?ChatGPT背后的人工智能安全隐患与对策(21财经)