一行代码加速大模型训练

- 量子位

- 2024-12-04 08:20:17

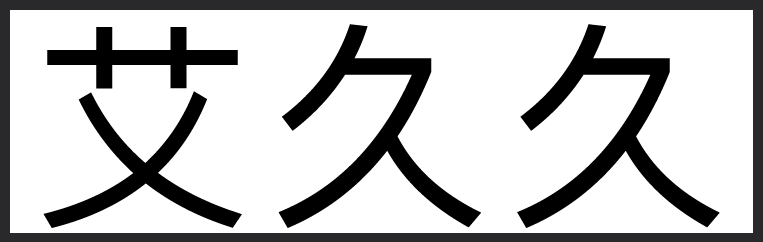

一行代码加速大模型训练

只要改一行代码,就能让大模型训练效率提升至1.47倍。

拥有得州大学奥斯汀分校背景四名华人学者,提出了大模型训练优化器Cautious Optimizers。

在提速的同时,Cautious能够保证训练效果不出现损失,而且语言和视觉模型都适用。

该优化器以哈密顿量和下降动力学为理论基础,在加速的同时不影响收敛特性。

作者在600M到1B不同参数规模的Llama模型上进行了试验,获得了最高47%的加速率。

该研究相关代码已经开源,在GitHub上有使用方法的详细讲解。

网页链接

网页链接

只要改一行代码,就能让大模型训练效率提升至1.47倍。

拥有得州大学奥斯汀分校背景四名华人学者,提出了大模型训练优化器Cautious Optimizers。

在提速的同时,Cautious能够保证训练效果不出现损失,而且语言和视觉模型都适用。

该优化器以哈密顿量和下降动力学为理论基础,在加速的同时不影响收敛特性。

作者在600M到1B不同参数规模的Llama模型上进行了试验,获得了最高47%的加速率。

该研究相关代码已经开源,在GitHub上有使用方法的详细讲解。

网页链接

网页链接