#模型时代# 扎克伯格回应DeepSeek竞争...

- 高飞

- 2025-02-06 01:47:04

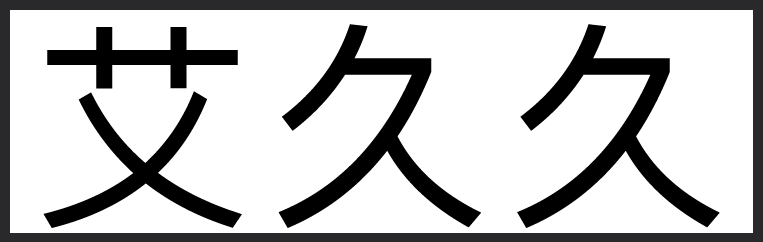

模型时代 扎克伯格回应DeepSeek竞争:Meta的目标是让Llama成为全球开源AI标准。

Meta刚刚公布了最新的2024年第4季度和全年财报。扎克伯格参加了和分析师的电话会议。我摘取了一下谈及人工智能的部分话题,当然,必然要谈到DeepSeek。

扎克伯格的回答很有技巧性:1、DeepSeek做了一些新颖的事情,有些对Meta也有参考性;2、DeepSeek的竞争,和其他对手的竞争没有什么区别。有人做的更好,大家就会接招PK;3、至于DeepSeek的训练成本低的问题,他认为训练成本占模型运行成本比例不高,推理阶段的计算投入可以提高智能水平和服务质量,所以AI算力需求还会继续保持。

2025年,Meta Llama和DeepSeek应该会有一番缠斗。

***

问答实录:

1、分析师提问:关于开源的问题,DeepSeek等模型可能会利用Llama或其他模型来更快、更低成本地训练,你认为这对Meta有何影响?这是否会改变未来几年Meta的投资轨迹?

今年的资本支出预计在600亿至650亿美元之间,相较于去年你们曾提到服务器是最大的一部分,其次是数据中心和网络设备,今年的构成有发生较大变化吗?在训练和推理之间的资源分配上,我们应该如何理解?特别是考虑到Yann本周的发文,想听听你的看法。谢谢。

扎克伯格:我先回答DeepSeek的问题。我认为他们做了一些新颖的事情,我们还在消化这些信息。他们的一些技术进展我们也希望能够在自身的系统中实现。这本身就是技术演进的一部分,无论竞争对手来自中国还是其他地方。

基本上,每家推出新模型的公司都会带来一些新的突破,整个行业都会从中学习。这就是科技行业的运作方式。

关于这对Meta基础设施投资和资本支出的影响,目前下结论还为时过早。这里有多个趋势在同时发生。

当前在计算基础设施的使用上,有一个正在讨论的问题,即有多少算力应该用于预训练,又有多少算力应该用于推理,因为现在的某些推理模型可以通过在推理阶段投入更多算力来获得更强的智能。这可能会影响我们如何分配计算资源。

在我们以及其他实验室看来,当前最有可能的趋势是,在整体计算资源的分配上,预训练所占的比例可能不会是最大的。但这并不意味着计算需求会减少,因为一个新的现象是,推理阶段的计算投入可以提高智能水平和服务质量。

对于像Meta这样拥有稳定商业模式的公司而言,这反而是一种优势。我们能够在推理阶段投入更多资源,从而提供更高质量的服务,而那些商业模式不够稳固的公司可能无法长期支撑这样的投入。

此外,我们在构建Meta AI的同时,也在将AI集成到信息流、广告产品等多个业务场景中。我们每天要服务数十亿用户,这与单纯训练一个大模型不同。训练一个模型时,它对最终使用人数并不敏感,而我们的业务则需要直接面向大量用户提供服务,这意味着我们的计算需求必然是庞大的。

总的来说,现在还很难判断这些趋势的最终影响。整个行业仍在快速发展,每个月都会有新的突破出现。我们会持续学习,并将新的技术进展融入到我们的体系中,同时也会对行业做出我们自己的贡献。

从长期来看,我仍然认为在资本支出和基础设施上的大规模投资是我们的战略优势。或许未来某个时候我们会有不同的认知,但目前来看,构建强大的计算基础设施将是一个重要的竞争优势,不仅有助于提升服务质量,也能支持我们达到目标规模。

2、分析师提问:我想回到关于开源的问题。能否请你谈谈你对Meta的开源策略的看法如何随着行业竞争格局的变化而演进?另外,你认为这种开源策略如何在中长期降低成本曲线并提高AI的资本回报?谢谢。

扎克伯格:是的,关于开源,我认为最好的类比是我们过去在**开放计算(Open Compute)**方面的做法。当时,我们并不是最早开发这类系统的公司,因此当我们开始构建它时,保持专有并不会带来太大优势。于是我们选择了开源。

最终,整个行业都采用了我们的技术,并对其进行创新改进,而标准化的过程也让供应链更具效率,降低了成本。

在AI领域也是类似的情况。随着Llama被越来越多地使用,芯片供应商、API开发者和其他平台都会更倾向于针对Llama进行优化,这将降低其使用成本,并推动相关技术改进,而我们也能够受益于这些改进。

因此,我认为这一策略仍然是有效的,并且我对它仍然充满信心。从近期的情况来看,比如中国的DeepSeek等新竞争对手的出现,我们也在关注未来是否会有一个全球化的开源标准。

从国家竞争优势的角度来看,我认为确保这一开源标准由美国主导是非常重要的。因此,我们将继续投入资源,确保我们构建的AI系统能够被全球广泛使用。而近期的一些行业动态也进一步增强了我们的信念,即开源是我们应该坚持的正确方向。

3、分析师提问:Mark,我知道今年有许多令人兴奋的创新,你们也会陆续发布多个重要公告。能否谈谈你的高层愿景,特别是Llama 4和Meta AI在2025年可能带来的新用例?这些技术如何提升用户体验并为广告商创造价值?

另外,关于定制芯片,我想问你们在自研芯片与第三方芯片在排名模型和推理方面的表现有什么关键区别?我们应该如何理解你们在内部加速自研芯片部署的进程?

扎克伯格:关于你的第一个问题,我在开场时已经提到了一些内容。我们非常专注于将Meta AI打造为一个高度智能化、个性化的助手,它可以在我们的应用中访问,也可以通过独立网站访问。

随着技术的发展,我们在不断改进AI的质量,同时也在探索如何更好地将其集成到我们的服务中,让更多人能够轻松发现并使用它。

关于Llama 4,我确实认为它会是一个非常令人兴奋的发布。它不会只是一个单独的模型,而是类似Llama 3的发布方式,会有多个版本在不同时间点推出。

至于AI工程师(AI Engineer)项目,我对此非常期待。尽管短期内可能不会成为一个独立的对外产品,但它将大幅提升我们的内部AI研发能力,并可能在2026年及以后带来更深远的影响。

关于自研芯片的问题,我们仍在学习它与第三方芯片的性能差异,以及如何加速其在生产环境中的应用。这是一个重要的方向,但目前我们还处于早期阶段,具体的进展我们会在合适的时间点分享更多信息。

4、分析师提问:Mark,我们最近看到OpenAI演示了他们的智能体(Operator)。随着行业从聊天模式向具备更强商业意图的智能体发展,你如何看待Meta AI的商业化潜力?Llama 4在推理能力上的增强是否会推动Meta AI提供更多智能体体验?

扎克伯格:关于智能体和推理能力,关键在于执行多步任务的能力。当前的许多系统仍然是单轮交互的,但未来的发展方向是,用户可以给出一个任务目标,然后AI可以自主调用大量计算资源去完成它。

例如,一个简单的任务可能是购买某样商品,而复杂的任务可能是编写并优化一款应用。这些应用场景将在未来一两年内越来越普遍。

我们通常的产品开发路径是先构建产品→扩大规模→再考虑商业化。所以短期内,Meta AI的商业价值可能还不会完全体现,但2025年最重要的目标是实现规模化增长,并为未来的变现奠定基础。

最后总结一下扎克伯格的主要观点:

开源战略:Llama 4 继续开源,Meta 目标是让 Llama 成为全球开源 AI 标准,以抗衡 DeepSeek 等新兴开源模型。

计算资源优化:推理计算的重要性提升,Meta 仍将大规模投资 AI 计算基础设施。

AI 发展:Meta AI 助手和 Llama 4 是未来增长的核心。

商业化路径:短期内仍以广告优化为主,智能体变现将在 2026 年及以后。

自研芯片:长期优化 AI 计算,提升推理效率。

Meta刚刚公布了最新的2024年第4季度和全年财报。扎克伯格参加了和分析师的电话会议。我摘取了一下谈及人工智能的部分话题,当然,必然要谈到DeepSeek。

扎克伯格的回答很有技巧性:1、DeepSeek做了一些新颖的事情,有些对Meta也有参考性;2、DeepSeek的竞争,和其他对手的竞争没有什么区别。有人做的更好,大家就会接招PK;3、至于DeepSeek的训练成本低的问题,他认为训练成本占模型运行成本比例不高,推理阶段的计算投入可以提高智能水平和服务质量,所以AI算力需求还会继续保持。

2025年,Meta Llama和DeepSeek应该会有一番缠斗。

***

问答实录:

1、分析师提问:关于开源的问题,DeepSeek等模型可能会利用Llama或其他模型来更快、更低成本地训练,你认为这对Meta有何影响?这是否会改变未来几年Meta的投资轨迹?

今年的资本支出预计在600亿至650亿美元之间,相较于去年你们曾提到服务器是最大的一部分,其次是数据中心和网络设备,今年的构成有发生较大变化吗?在训练和推理之间的资源分配上,我们应该如何理解?特别是考虑到Yann本周的发文,想听听你的看法。谢谢。

扎克伯格:我先回答DeepSeek的问题。我认为他们做了一些新颖的事情,我们还在消化这些信息。他们的一些技术进展我们也希望能够在自身的系统中实现。这本身就是技术演进的一部分,无论竞争对手来自中国还是其他地方。

基本上,每家推出新模型的公司都会带来一些新的突破,整个行业都会从中学习。这就是科技行业的运作方式。

关于这对Meta基础设施投资和资本支出的影响,目前下结论还为时过早。这里有多个趋势在同时发生。

当前在计算基础设施的使用上,有一个正在讨论的问题,即有多少算力应该用于预训练,又有多少算力应该用于推理,因为现在的某些推理模型可以通过在推理阶段投入更多算力来获得更强的智能。这可能会影响我们如何分配计算资源。

在我们以及其他实验室看来,当前最有可能的趋势是,在整体计算资源的分配上,预训练所占的比例可能不会是最大的。但这并不意味着计算需求会减少,因为一个新的现象是,推理阶段的计算投入可以提高智能水平和服务质量。

对于像Meta这样拥有稳定商业模式的公司而言,这反而是一种优势。我们能够在推理阶段投入更多资源,从而提供更高质量的服务,而那些商业模式不够稳固的公司可能无法长期支撑这样的投入。

此外,我们在构建Meta AI的同时,也在将AI集成到信息流、广告产品等多个业务场景中。我们每天要服务数十亿用户,这与单纯训练一个大模型不同。训练一个模型时,它对最终使用人数并不敏感,而我们的业务则需要直接面向大量用户提供服务,这意味着我们的计算需求必然是庞大的。

总的来说,现在还很难判断这些趋势的最终影响。整个行业仍在快速发展,每个月都会有新的突破出现。我们会持续学习,并将新的技术进展融入到我们的体系中,同时也会对行业做出我们自己的贡献。

从长期来看,我仍然认为在资本支出和基础设施上的大规模投资是我们的战略优势。或许未来某个时候我们会有不同的认知,但目前来看,构建强大的计算基础设施将是一个重要的竞争优势,不仅有助于提升服务质量,也能支持我们达到目标规模。

2、分析师提问:我想回到关于开源的问题。能否请你谈谈你对Meta的开源策略的看法如何随着行业竞争格局的变化而演进?另外,你认为这种开源策略如何在中长期降低成本曲线并提高AI的资本回报?谢谢。

扎克伯格:是的,关于开源,我认为最好的类比是我们过去在**开放计算(Open Compute)**方面的做法。当时,我们并不是最早开发这类系统的公司,因此当我们开始构建它时,保持专有并不会带来太大优势。于是我们选择了开源。

最终,整个行业都采用了我们的技术,并对其进行创新改进,而标准化的过程也让供应链更具效率,降低了成本。

在AI领域也是类似的情况。随着Llama被越来越多地使用,芯片供应商、API开发者和其他平台都会更倾向于针对Llama进行优化,这将降低其使用成本,并推动相关技术改进,而我们也能够受益于这些改进。

因此,我认为这一策略仍然是有效的,并且我对它仍然充满信心。从近期的情况来看,比如中国的DeepSeek等新竞争对手的出现,我们也在关注未来是否会有一个全球化的开源标准。

从国家竞争优势的角度来看,我认为确保这一开源标准由美国主导是非常重要的。因此,我们将继续投入资源,确保我们构建的AI系统能够被全球广泛使用。而近期的一些行业动态也进一步增强了我们的信念,即开源是我们应该坚持的正确方向。

3、分析师提问:Mark,我知道今年有许多令人兴奋的创新,你们也会陆续发布多个重要公告。能否谈谈你的高层愿景,特别是Llama 4和Meta AI在2025年可能带来的新用例?这些技术如何提升用户体验并为广告商创造价值?

另外,关于定制芯片,我想问你们在自研芯片与第三方芯片在排名模型和推理方面的表现有什么关键区别?我们应该如何理解你们在内部加速自研芯片部署的进程?

扎克伯格:关于你的第一个问题,我在开场时已经提到了一些内容。我们非常专注于将Meta AI打造为一个高度智能化、个性化的助手,它可以在我们的应用中访问,也可以通过独立网站访问。

随着技术的发展,我们在不断改进AI的质量,同时也在探索如何更好地将其集成到我们的服务中,让更多人能够轻松发现并使用它。

关于Llama 4,我确实认为它会是一个非常令人兴奋的发布。它不会只是一个单独的模型,而是类似Llama 3的发布方式,会有多个版本在不同时间点推出。

至于AI工程师(AI Engineer)项目,我对此非常期待。尽管短期内可能不会成为一个独立的对外产品,但它将大幅提升我们的内部AI研发能力,并可能在2026年及以后带来更深远的影响。

关于自研芯片的问题,我们仍在学习它与第三方芯片的性能差异,以及如何加速其在生产环境中的应用。这是一个重要的方向,但目前我们还处于早期阶段,具体的进展我们会在合适的时间点分享更多信息。

4、分析师提问:Mark,我们最近看到OpenAI演示了他们的智能体(Operator)。随着行业从聊天模式向具备更强商业意图的智能体发展,你如何看待Meta AI的商业化潜力?Llama 4在推理能力上的增强是否会推动Meta AI提供更多智能体体验?

扎克伯格:关于智能体和推理能力,关键在于执行多步任务的能力。当前的许多系统仍然是单轮交互的,但未来的发展方向是,用户可以给出一个任务目标,然后AI可以自主调用大量计算资源去完成它。

例如,一个简单的任务可能是购买某样商品,而复杂的任务可能是编写并优化一款应用。这些应用场景将在未来一两年内越来越普遍。

我们通常的产品开发路径是先构建产品→扩大规模→再考虑商业化。所以短期内,Meta AI的商业价值可能还不会完全体现,但2025年最重要的目标是实现规模化增长,并为未来的变现奠定基础。

最后总结一下扎克伯格的主要观点:

开源战略:Llama 4 继续开源,Meta 目标是让 Llama 成为全球开源 AI 标准,以抗衡 DeepSeek 等新兴开源模型。

计算资源优化:推理计算的重要性提升,Meta 仍将大规模投资 AI 计算基础设施。

AI 发展:Meta AI 助手和 Llama 4 是未来增长的核心。

商业化路径:短期内仍以广告优化为主,智能体变现将在 2026 年及以后。

自研芯片:长期优化 AI 计算,提升推理效率。